Politika

Analize i izvještaji o političkim dešavanjima.

Svjetske Vijesti

Globalne vijesti i međunarodni događaji.

Tehnologija

Svijet tehnoloških inovacija, savremenih uređaja, video igara, aplikacija i vještačke inteligencije.

Zdravlje i Um

Savjeti za zdravlje, vježbanje i nutricionizam.

Zanimljivosti

Razne zanimljivosti iz svijeta

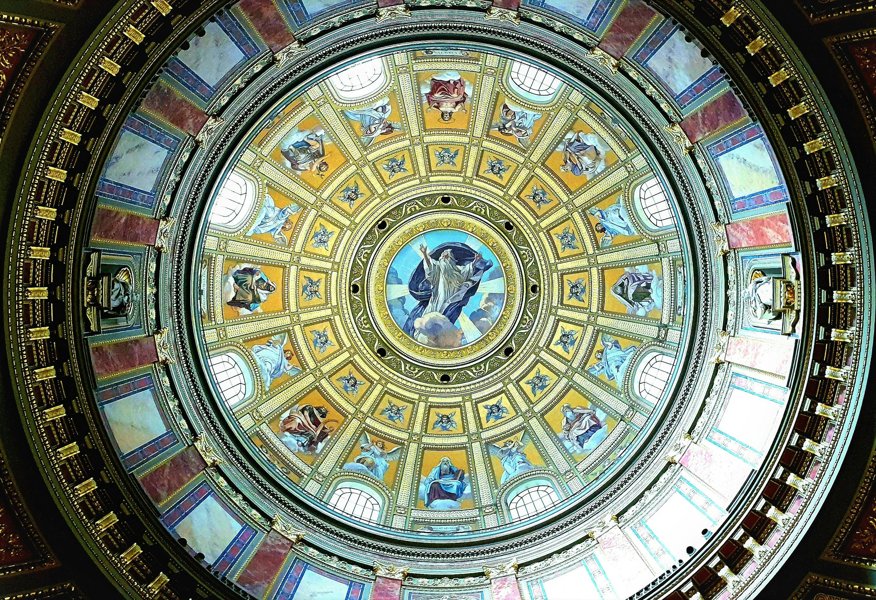

Društvene Nauke

Istražite teme poput ekonomije, istorije i umjetnosti

Planeta i Svemir

Najnovija otkrića i vijesti iz svemira.

Misterije

Misteriozne pojave i teorije zavjera

IT Vijesti

Najnovije informacije iz IT industrije.

Domaće vijesti

Vijesti fokusirane na područije Balkana

Sport

0 Komentara